Sommaire

Les Premières Fruits de la Visualisation des Données : Des Cartes Anciennes aux Pionniers du XIXe Siècle

La visualisation des données, bien que considérée aujourd’hui comme une compétence numérique sophistiquée, puise ses racines dans des pratiques anciennes remontant à plusieurs siècles. Dès le XVIIIe siècle, la nécessité de représenter graphiquement des informations complexes a conduit à la création de cartes détaillées. Ces cartes ne visaient pas seulement à délimiter des territoires, mais aussi à dresser un inventaire visuel des ressources et des phénomènes observés, un système qui rappelle fortement les méthodes utilisées en géomatique contemporaine.

Parmi les figures marquantes du XIXe siècle, William Playfair apparaît comme un véritable pionnier dans l’élaboration de graphiques statistiques. Il est notamment reconnu pour avoir inventé des formes graphiques désormais incontournables, telles que l’histogramme, le graphique en barres et le graphique en secteurs. Ces représentations ont révolutionné la manière de traiter et d’interpréter les données numériques, offrant une interface visuelle plus accessible pour la compréhension de grandes séries de chiffres.

Un autre acteur clé de ce siècle est Florence Nightingale, dont l’utilisation novatrice de diagrammes en rose (diagrammes polaires) a permis de dévoiler, en temps réel, l’ampleur tragique des pertes humaines liées aux conditions sanitaires lors de la guerre de Crimée. Son travail démontre comment la visualisation des données peut transcender la simple présentation des chiffres pour devenir un levier puissant de sensibilisation et de réforme sociale.

Dans cette optique, John Snow utilise la cartographie des cas de choléra à Londres pour identifier une source commune d’infection. Ce travail est une illustration précoce de la santé publique alimentée par la science des données visuelles, où la superposition des informations géographiques avec des statistiques de santé offre un moyen inédit de lutter contre les épidémies.

Ces premiers outils et méthodes posent alors les jalons fondamentaux de la data visualisation, confirmant que l’utilité première de ces techniques est de transformer des données brutes en informations signifiantes, facilitant ainsi la prise de décision éclairée.

L’Émergence des Outils Informatiques et Leur Influence Sur la Visualisation des Données

L’informatique a bouleversé au XXe siècle la façon dont les données sont traitées et représentées visuellement. Le lancement des premiers tableurs électroniques dans les années 1970 a simplifié la manipulation des données, facilitant ainsi la création de graphiques dynamiques et personnalisables. Cette révolution technique a mis l’analyse des données à la portée d’un public beaucoup plus large, dont les entreprises et les chercheurs qui ont alors pu optimiser leurs processus décisionnels.

Les logiciels statistiques comme SAS et SPSS sont apparus dans les années 1980 et 1990, offrant des capacités avancées pour traiter et visualiser des données complexes. Ces outils ont rendu possible une exploration approfondie des corrélations et des tendances, auparavant difficiles à cerner, mettant en lumière un nouveau champ d’étude.

L’avènement d’Internet et le développement exponentiel du Big Data ont offert une nouvelle dimension à la visualisation des données. Des plateformes modernes comme Tableau, Microsoft Power BI et Google Data Studio ont rendu possible la création d’interfaces graphiques interactives accessibles via navigateur. Ces solutions ont non seulement démocratisé l’accès à la data visualisation, mais elles ont aussi multiplié les usages, allant de l’analyse marketing à la gestion opérationnelle en milieu industriel.

Ce tournant numérique a permis d’abaisser les barrières techniques, offrant aux professionnels la possibilité d’intégrer plus facilement la data visualisation dans leur environnement quotidien. Cette accessibilité a enrichi la culture décisionnelle en donnant aux utilisateurs les moyens d’explorer les données avec davantage de souplesse et précision.

Ce nouveau contexte technologique a posé les bases d’une transformation profonde des métiers liés à l’analyse de données, en privilégiant des compétences hybrides mêlant maîtrise technique et sensibilité à la narration visuelle.

L’Essor de l’Interactivité : Vers une Exploration Plus Dynamique des Données

Au fil des décennies qui suivirent, la dimension interactive s’est imposée comme une caractéristique incontournable de la data visualisation. Plutôt que de se contenter d’une lecture passive, l’utilisateur est désormais invité à interagir avec les représentations graphiques pour en extraire des insights personnalisés. Ce changement de paradigme s’appuie notamment sur l’intégration d’éléments dynamiques permettant de filtrer, zoomer ou reconfigurer le visuel en temps réel.

Cette capacité d’explorer les données sous différents angles aide à découvrir des nuances et des corrélations subtiles. Par exemple, un responsable marketing peut, grâce à une plateforme interactive, ajuster instantanément les paramètres d’une campagne publicitaire et visualiser immédiatement les variations de performance. Ce retour d’information immédiat favorise une meilleure agilité décisionnelle.

Les librairies JavaScript telles que D3.js jouent un rôle crucial en offrant aux développeurs la flexibilité nécessaire pour concevoir des visualisations riches et évolutives. En personnalisant entièrement les interactions et en tirant profit des capacités web modernes, ces outils permettent de concevoir des expériences utilisateur très sophistiquées, adaptées aux besoins les plus spécifiques.

Au-delà d’un simple aspect esthétique, l’interactivité provoque une implication accrue des utilisateurs, transformant la compréhension des données en une démarche active et réflexive. Ce changement reflète aussi une évolution socioculturelle où la participation et la personnalisation sont devenues des moteurs puissants dans l’adoption des technologies.

Dans ce contexte, l’interactivité représente non seulement une évolution technique mais constitue aussi un véritable accélérateur d’intelligence collective, offrant à chaque acteur la possibilité de forger ses propres interprétations et hypothèses à partir des données disponibles.

L’Héritage de Visionnaires et de Théoriciens dans l’Évolution de la Data Visualisation

Le progrès dans le domaine de la visualisation des données ne s’appuie pas uniquement sur les outils techniques, mais aussi sur les contributions intellectuelles majeures de certains spécialistes. Parmi les figures emblématiques, Edward Tufte est souvent considéré comme le père de la visualisation moderne. Son travail a mis en lumière l’importance de la clarté, de la précision et de l’élimination du superflu dans la présentation graphique des données.

Tufte a souligné que chaque élément visuel doit avoir une fonction précise, afin d’éviter les distractions inutiles qui obscurcissent les messages essentiels. Ses principes continuent d’influencer la conception des dashboards et des rapports analytiques, notamment dans les environnements professionnels où la prise de décision rapide repose sur la qualité de la représentation visuelle.

Par ailleurs, Charles Joseph Minard a marqué l’histoire avec sa célèbre carte quantitative illustrant la retraite de l’armée napoléonienne de Russie. Cette représentation combinait géographie, quantité d’hommes, températures et dates, offrant un récit visuel d’une efficacité rare. Elle est fréquemment citée comme l’un des meilleurs exemples d’intégration multidimensionnelle dans une seule visualisation.

L’approche de ces auteurs a nourri le développement des méthodes d’analyse graphique, en invitant à une réflexion plus critique sur la manière dont les données sont traduites en images. Cette quête de la visualisation parfaite est restée un leitmotiv dans l’évolution de la discipline, s’adaptant sans cesse aux nouveautés technologiques tout en conservant une rigueur intellectuelle fondamentale.

En 2025, cet héritage inspire encore les fabricants de logiciels et les concepteurs d’outils comme Tableau et Microsoft Power BI, qui intègrent ces principes pour proposer des interfaces alliant esthétisme et efficacité cognitive. Cette combinaison contribue à renforcer la confiance des utilisateurs dans leurs analyses et à faire de la data visualisation un moteur incontournable dans les processus décisionnels.

La Visualisation des Données Dans le Monde de la Santé : Une Pratique Ancienne et Toujours Innovante

Le secteur médical a été un terrain fertile pour les premières applications significatives de la data visualisation. Le travail de Florence Nightingale demeure symbolique, car il démontre comment la représentation graphique pouvait directement influencer les politiques sanitaires. En exposant ouvertement les chiffres alarmants de mortalité, ses diagrammes ont aidé à mobiliser les autorités pour améliorer les conditions d’hygiène dans les hôpitaux.

À l’ère contemporaine, cette tradition se perpétue avec des outils permettant de visualiser des données épidémiologiques en temps réel. Par exemple, lors de la gestion récente de la pandémie mondiale, les cartes interactives fournies par divers organismes de santé publique ont permis de suivre la propagation du virus et d’anticiper les besoins en ressources médicales.

L’intégration des données spatialisées se révèle cruciale, rappelant le travail précurseur de John Snow. En combinant les capacités des technologies modernes avec des bases de données exhaustives, les analystes peuvent désormais détecter des clusters épidémiologiques avec une précision inédite. Ces visualisations permettent aussi de simuler des scénarios et de tester l’impact potentiel de mesures sanitaires différentes.

Des plateformes dédiées combinent ainsi cartographie, statistiques et interactivité afin d’offrir une compréhension approfondie des dynamiques de santé publique. Cette approche favorise une collaboration efficace entre praticiens, décideurs et chercheurs, renforçant la réactivité face aux crises sanitaires.

L’évolution de la data visualisation dans ce domaine souligne l’importance vitale des représentations graphiques pour transformer des masses d’informations complexes en messages clairs, indispensables à la sauvegarde des populations.

Les Outils Modernes et Leur Place dans l’Écosystème de la Visualisation des Données en 2025

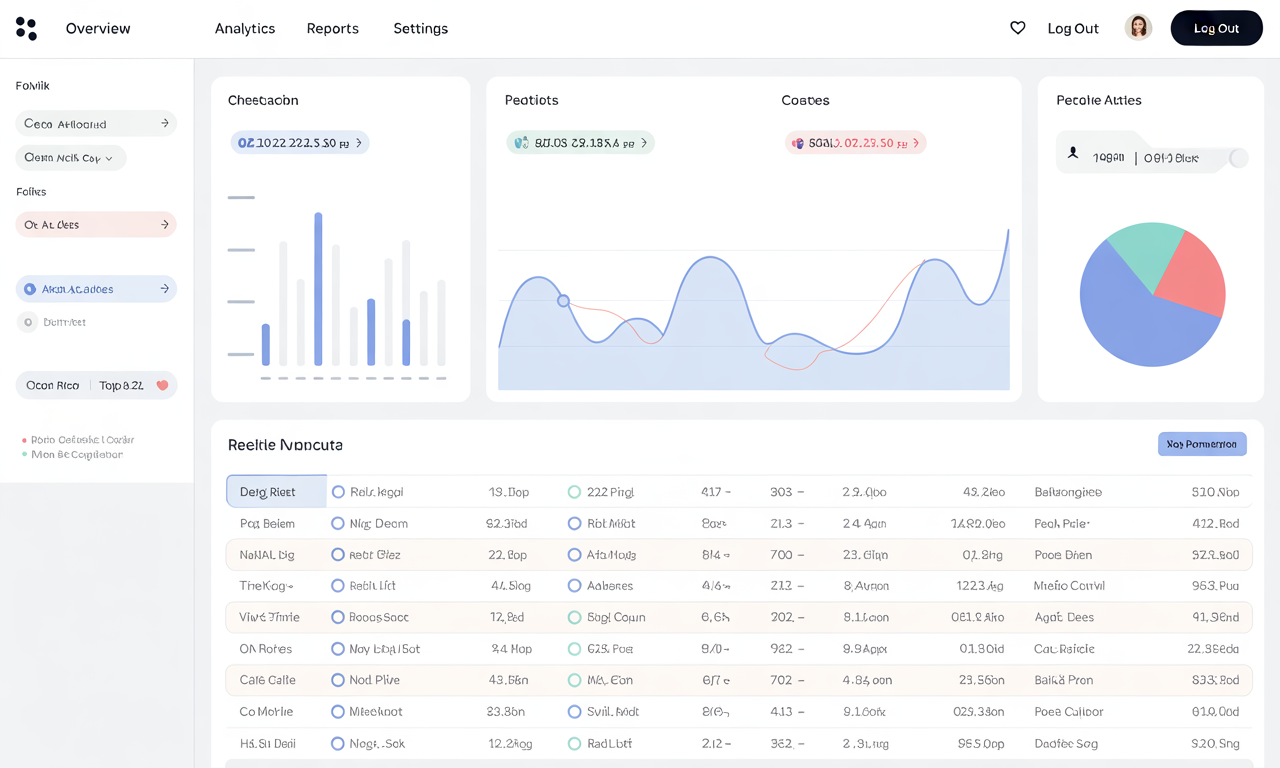

En 2025, la palette d’outils à disposition des professionnels est plus diverse et puissante que jamais. Tableau demeure une référence pour la création de dashboards intuitifs et dynamiques, utilisés dans des secteurs aussi variés que la finance, l’industrie ou la distribution. Son interface conviviale favorise une adoption rapide, même par des utilisateurs non spécialistes.

Microsoft Power BI s’est également imposé comme un leader grâce à son intégration native aux plateformes Microsoft, facilitant ainsi le traitement de données issues de sources hétérogènes. Les fonctionnalités avancées d’analyse prédictive et de machine learning y sont maintenant couramment exploitées pour anticiper les résultats et tendances futures.

En parallèle, pour des besoins de personnalisation et de flexibilité extrêmes, D3.js reste l’outil privilégié des développeurs web spécialisés. Sa capacité à générer des visualisations sur mesure, adaptatives et performantes en fait un composant essentiel des projets à forte valeur ajoutée en matière d’expérience utilisateur.

Google Data Studio contribue à l’accessibilité de la data visualisation grâce à sa gratuité et son intégration fluide avec les sources de données Google, notamment pour les performances web et marketing. Cette solution séduit particulièrement les startups et les petites structures recherchant une réponse rapide et économique.

Cette diversité d’outils traduit les besoins multiples et spécifiques des utilisateurs d’aujourd’hui, qui souhaitent combiner facilité d’usage, puissance d’analyse, et capacité d’intégration. Ainsi, la data visualisation en 2025 s’est transformée en un écosystème riche, permettant une exploitation optimale des données quel que soit le contexte ou le secteur d’activité.

La Révolution des Données Massives et du Big Data : Nouveaux Enjeux et Opportunités

L’explosion des volumes de données a marqué un tournant majeur dans la façon dont les informations sont visualisées. Le flux continu et massif de données, aussi appelé Big Data, impose de repenser tant les structures de stockage que les modalités d’analyse. Dans ce cadre, la visualisation ne peut plus être un simple exercice statique mais doit devenir capable de synthétiser rapidement d’immenses ensembles d’informations.

Les outils modernes cherchent à relever ce défi en multipliant les capacités d’agrégation et de filtrage automatique. Ces fonctionnalités s’appuient souvent sur des moteurs analytiques avancés et sur l’intégration du machine learning pour orienter l’utilisateur vers les insights les plus pertinents. Par exemple, dans le domaine industriel, des plateformes spécialisées affichent en temps réel des indicateurs clés de performance, permettant une maintenance prédictive qui réduit les temps d’arrêt des machines.

De plus, le traitement des données en streaming, utilisé dans des secteurs comme la finance ou les réseaux sociaux, facilite le déploiement de visualisations en direct, monitorant l’évolution des marchés ou des tendances publiques. Ces évolutions nécessitent des interfaces aussi lisibles que réactives, alliant rapidité d’exploration et profondeur d’analyse.

Les enjeux liés à la sécurité et à l’intimité des données se posent également avec acuité dans ce contexte. Les solutions de visualisation doivent intégrer des protocoles garantissant la confidentialité tout en offrant une transparence adaptée aux utilisateurs. Cela demande une vigilance constante dans la conception des outils et dans les pratiques de gestion.

L’adaptabilité de la visualisation des données face à la croissance exponentielle des informations est une condition sine qua non pour maintenir son rôle central dans les processus décisionnels contemporains.

Intelligence Artificielle et Visualisation des Données : Une Synergie Porteuse d’Innovation

La dernière décennie a été le théâtre d’une intégration croissante de l’intelligence artificielle (IA) dans les pratiques de data visualisation. L’IA apporte des capacités inédites d’analyse prédictive et d’automatisation, qui révolutionnent la manière dont les données sont exploitées.

Des algorithmes capables d’apprendre grâce à l’analyse de patterns complexes fournissent aujourd’hui des recommandations sur le choix des meilleures représentations graphiques adaptées à la nature des données. Ces systèmes, intelligents, allègent la charge cognitive des utilisateurs en suggérant des visualisations qui maximisent la compréhension et la pertinence.

Par ailleurs, l’IA contribue à la génération automatique de rapports visuels complets, traitant des volumes considérables d’informations en un temps record. Par exemple, dans la finance, les outils pilotés par l’IA peuvent anticiper les fluctuations du marché en intégrant des données historiques et des signaux en temps réel, puis synthétiser ces informations en dashboards compréhensibles par les analystes.

Cette convergence entre intelligence humaine et computation automatisée ouvre également la voie à la création d’environnements interactifs où l’utilisateur dialogue avec les données. La personnalisation des interfaces selon le profil de chaque utilisateur optimise ainsi l’expérience, rendant la visualisation encore plus accessible et pertinente.

L’essor de l’intelligence artificielle dans le domaine de la data visualisation marque une étape décisive qui devrait s’amplifier dans les années à venir, renforçant le rôle critique de cette discipline au cœur des prises de décision stratégiques.